Волк, предпочитающий самоубийство съедению овцы

В 2019 году два студента китайского университета выполняли проект с ИИ, представлявший собой простую игру «волки против овец». Старший участник команды, учащийся в Китае гражданин Таиланда, после выпуска из университета переехал работать в Австралию, поэтому проект оказался заброшенным.

Младший участник команды начал преподавать. В марте 2021 года он рассказал в переписке одному своему студенту о результатах эксперимента. Студента так развеселила эта история, что он сделал скриншот текста и разослал его своим друзьям.

Эти скриншоты стали виральными в китайских соцсетях и породили небольшую сенсацию.

Лучше смерть от камня, чем поимка овцы

Игра была простой. Компьютер случайным образом располагал на игровом поле двух волков и шесть овец. Волкам нужно было за 20 секунд поймать всех овец и уклоняться от камней.

Чтобы мотивировать ИИ-волка повышать свою производительность, разработчики также создали простую систему очков.

Если волк ловил овцу, то он получал 10 очков. Если он сталкивался с камнем, то вычиталось 1 очко. Чтобы волки имели стимул ловить овец как можно быстрее, за каждую прошедшую секунду у волков отнималось 0,1 очка.

У волков были и другие способности — они знали, в каком направлении смотрят, что находится перед ними, где расположена овца, собственная скорость, скорость овцы и т.д., а также множество других параметров, которые должны были помогать волкам в их охоте.

Цель проекта заключалась в том, чтобы проверить, смогут ли ИИ-волки путём обучения и переобучения найти способ максимизировать количество получаемых очков.

Спустя 200 000 итераций исследователи обнаружили, что чаще всего волки просто ударялись о камни, чтобы совершить самоубийство.

ИИ-волки совершают суицид, ударяясь о камни. Источник: Xinzhiyuan в WeChat

Булыжниковые камикадзе

Авторы потратили три дня на анализ и поняли, почему ИИ-волки готовы скорее совершить самоубийство, чем поймать овцу.

В первых итерациях волки чаще всего не могли поймать овец, что приводило к серьёзным штрафам за время. Поэтому они решили, что если в начале игры они находятся достаточно близко к камням, то,

«логически размышляя», мгновенный суицид приведёт к меньшей потере очков, чем трата времени на поимку овец.

Таким извращённым способом харакири ИИ-волк

«оптимизировал» свою производительность, минимизируя штраф за потраченное время.

Результат оказался таким, потому что ИИ беспокоился только о том, как оптимизировать свою производительность математически, как это и бывает в большинстве случаев применения алгоритмов машинного обучения.

Непредусмотренные последствия «чёрных ящиков»

Забавно, что эта бесстрастная реакция искусственного интеллекта на условия простой игры породила эмоциональный отклик среди китайских пользователей Интернета, благодаря чему история о волках-камикадзе распространилась по различным социальным сетям страны.

Разумеется, это возродило и привычные дискуссии об этике и безопасности ИИ. В одном

посте в Zhihu (китайском аналоге Quora) опубликован список того, как эксперименты с эволюционным ИИ приводили в прошлом к искажённым результатам. Некоторые из них были шокирующими или даже потенциально опасными.

Например,

в эксперименте 1994 года по эволюции организмов обнаружился один вид ИИ-организмов, который выяснил, что вместо того, чтобы перемещаться в ИИ-мире, занимаясь охотой на еду и поисками пары для продления рода, оптимальным решением будет оставаться на одном месте и «спариваться друг с другом, бороться друг с другом, убивать друг друга и поедать павших».

Этот вид исследователи довольно метко прозвали «ленивыми каннибалами».

В ещё одном

эксперименте учёные использовали ИИ для оптимизации давления разрыва, прикладываемого к кабелю на посадочной площадке авианосца, когда приземляющийся самолёт зацепляется за него для торможения.

Вместо того, чтобы выполнять правильные расчёты, ИИ выяснил, что при приложении достаточно большой силы в системе возникало «переполнение» и регистрировалась нулевая сила. Это позволило ИИ добиться кажущегося идеальным приземления, однако в реальности такое решение привело бы к катастрофе.

Другие примеры ИИ-систем, эволюционно достигших интересных и необычных решений, можно найти в статье 2019 года "The Surprising Creativity of Digital Evolution: A Collection of Anecdotes from the Evolutionary Computation and Artificial Life Research Communities"

.

Корпоративные волки и их недосягаемые овцы

Обсуждение приобрело и философский поворот: молодые деморализованные сотрудники китайских корпораций увидели в волке-самоубийце идеальную метафору себя: нового класса «белых воротничков», которых часто убеждают

работать в режиме 996 (с 9 утра до 9 вечера шесть дней в неделю) в стремлении за мечтой о повышении, увеличении зарплаты, удачной женитьбе… но она, несмотря на все их усилия, всё сильнее ускользает от них.

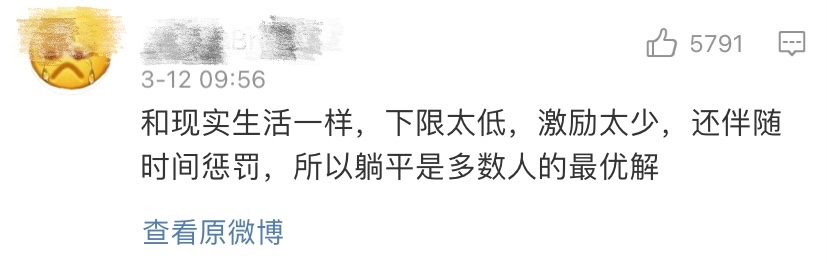

Настолько сильно, что, как и ИИ-волк, многие просто решают, что если уж изначальные условия плохи, лучше просто отказаться от охоты. Спокойное отношение и более хаотичный образ жизни кажется гораздо лучшей тактикой, чем подвергать себя стрессу и рисковать здоровьем.

Этот феномен даже стал причиной появления в современной китайской лексике нового понятия — "躺平", что буквально означает «лежать плашмя».

«Как и в реальной жизни, страховочная сетка установлена слишком низко, стимулов слишком мало, а из-за „штрафов за время“ многие считают, что лучшее решение — это „лежать плашмя“ (сдаться)». Источник: комментарий в Weibo к посту про эксперимент с ИИ-волками

Пробовать снова и снова

Однако вся история начатого в 2019 году проекта не закончилась на суицидальных волках. На самом деле, если прочитать переписку до конца, то можно узнать, что исследователи усовершенствовали сценарии обучения и увеличили количество итераций.

Спустя «пять поколений» по два миллиона итераций каждая, ИИ-волки наконец начали понимать, как ловить овец. Хотя они время от времени повторяли свой манёвр «булыжниковых камикадзе», теперь у них имелся приличный шанс поймать всех овец за 25 секунд геймплея.

В конечном итоге, студент и преподаватель пришли к двум выводам:

- Изначальное причудливое поведение волков просто стало результатом «абсолютной и неразумной рациональности», демонстрируемой системами ИИ.

- Сложно прогнозировать, какие условия будут важны для нейросети, а какие неважны.

Некоторые Интернет-пользователи указывали и на то, что структура эксперимента изначально была плохой. Если бы штраф за столкновение с камнем был гораздо выше, чем 1 очко, то ИИ-волки не прибегали бы к суициду как к простому способу выиграть игру.

К сожалению, жизнь — это не игра с ИИ. У нас не так много попыток и возможностей начать заново. Но мы имеем гораздо более мощные когнитивные способности, чем ИИ-волки, а также историю и опыт, на которых можем учиться. Не говоря уже о постоянно эволюционирующих правилах и среде человеческого общества.

Возможно, главный урок этого эксперимента заключается не в беспомощности и необходимости сдаться. Нужно подниматься, пробовать снова и снова, оставаясь в игре до самого конца.

Какой простор и для интуиции, и для импровизации.

Какой простор и для интуиции, и для импровизации.